导语

这项研究让128名学习者分别用AI和传统工具完成头脑风暴与TRIZ设计任务,同时“读脑”“读脸”——用近红外脑成像监测前额叶激活,用表情识别分析情绪变化。结果发现:AI显著提升了创意表现,但也让学习者在头脑风暴时表现出更多恐惧和厌恶情绪。右侧前额叶的激活与负面情绪同步增强,而双侧激活才伴随快乐。

想了解你的创意课堂里,AI究竟是赋能还是增压?这篇最新研究给出了令人深思的答案。

方法的基本信息

这篇文章使用的研究方法主要是实验研究,但采用了多模态量化研究范式,此处将分别介绍整体的研究方法和功能性近红外光谱(fNIRS)这一方法。

核心思想

采用多模态量化研究范式——同步采集面部表情(外显情绪)、fNIRS(前额叶脑血氧)和专家创意评分——揭示生成式AI辅助创造性思维学习的认知‑情绪双刃剑效应。其中fNIRS技术用于监测创意过程中前额叶皮层(特别是DLPFC)的实时激活模式,以关联情绪侧化与认知控制。

独特价值

整体方法层面:

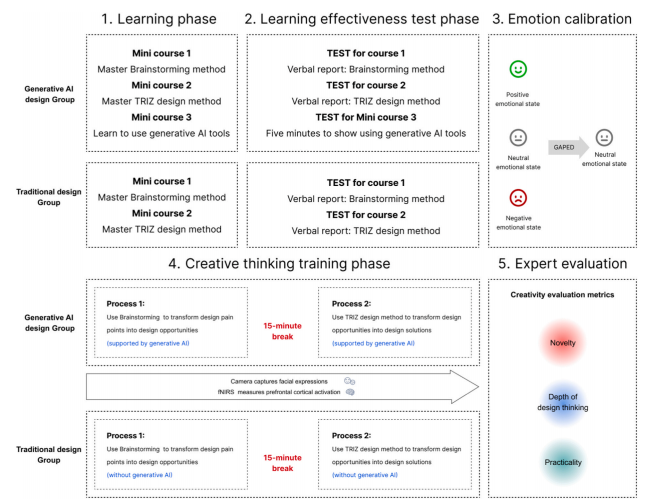

① 在创意教育中同时整合“行为(表情)‑神经(fNIRS)‑结果(专家评分)”三维数据;

② 对比两种经典创意方法(发散型头脑风暴 vs. 结构型TRIZ),揭示AI在不同认知阶段的不同影响;

③ 使用机器学习(CatBoost等)验证多模态数据对创意表现的分类能力(最高准确率91.40%)。

fNIRS技术层面:

① 高生态效度:允许学习者在自然坐姿、自由说话、正常操作电脑时采集,贴近真实课堂/设计场景;

② 时间分辨率适中(13.333 Hz),可捕捉创意任务中阶段性认知负荷变化;

③ 空间聚焦DLPFC:该脑区既参与工作记忆、认知灵活性(与创意控制相关),也参与情绪加工(左正/右负侧化),恰好切中“AI如何同时影响思考与情绪”的核心问题;

④ 与面部表情时序同步,可区分“即时情绪反应”与“后续认知加工负担”。

关键产出

① 头脑风暴阶段,AI组仅右侧DLPFC的HbO2浓度显著高于传统组(t(126)=14.86,p<.001,Cohen′sd=2.63),与负面情绪(恐惧、厌恶)增加同步;

② TRIZ阶段,AI组双侧DLPFC的HbO2浓度均显著高于传统组(左侧 t=3.86,d=0.68;右侧 t=14.86,d=2.63),与快乐情绪增加同步;

③ 验证了情绪侧化理论(左DLPFC与积极情绪、右DLPFC与消极情绪相关)。

方法的操作过程

上图是本研究的研究过程,不再赘述,此处重点介绍fNIRS的操作过程。

应用原则

-

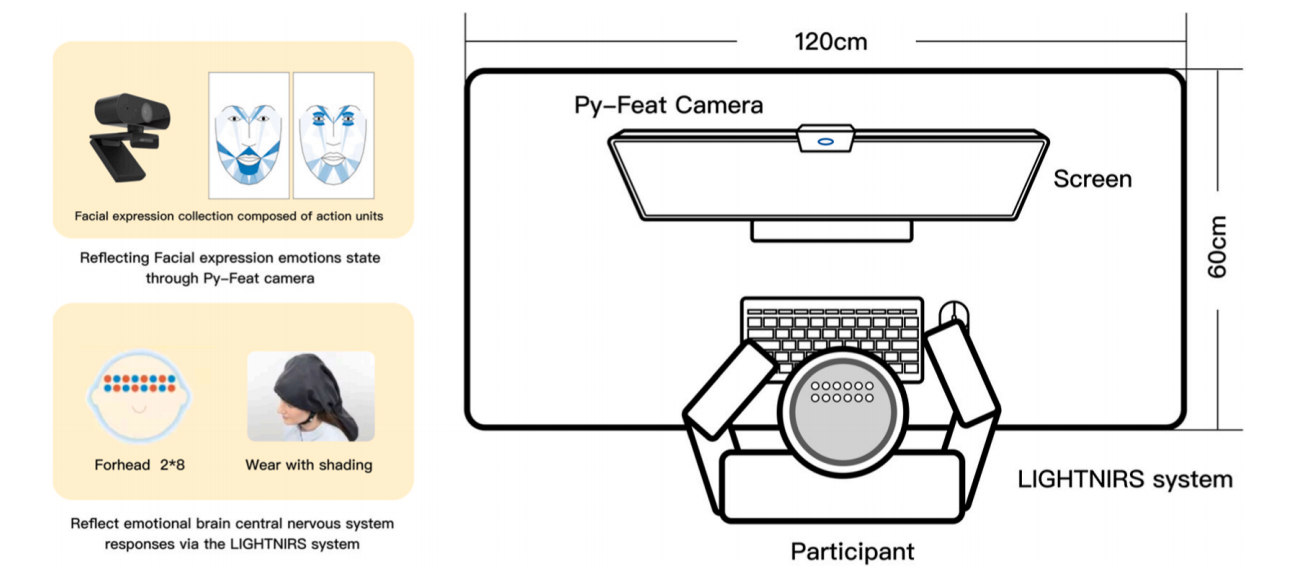

无创、低约束:fNIRS探头通过头帽固定,学习者可正常言语、打字、查看屏幕,不影响任务执行。

-

任务相关脑区聚焦:根据既往研究,创意过程中的认知控制与情绪加工主要涉及前额叶,特别是DLPFC。因此探头布局重点覆盖Fpz周围的左右DLPFC。

-

同步多模态采集:fNIRS与摄像头时间戳对齐,便于后续分析“情绪面部动作”与“脑区激活”的时序关系。

-

信号预处理标准化:采用修正的Beer-Lambert定律计算HbO2浓度,经去漂移(一阶多项式回归)、TDDR去运动伪迹、带通滤波(0.01–0.2 Hz)去除生理噪声。

操作步骤

①探头定位:

根据国际10-20系统,将探头矩阵中心置于Fpz位置。共22个通道(8个光源×8个探测器),使用FASTRAK三维定位仪记录每个通道的MNI坐标,确认覆盖左右DLPFC(BA9区)。

②信号采集:

LIGHTNIRS系统(岛津公司),三个波长(780, 805, 830 nm),采样频率13.333 Hz。在整个创意训练阶段(约30分钟)持续记录,包括:头脑风暴(15分钟)+休息(2分钟)+TRIZ设计(15分钟)

③数据预处理(MATLAB + NIRS_KIT):

光强转HbO2浓度:修正的Beer-Lambert定律

去漂移:一阶多项式回归

运动伪迹校正:TDDR(时域导数分布修复)

带通滤波:0.01–0.2 Hz(去除心跳、呼吸等高频噪声)

基线校正:以情绪校准阶段的60秒静息态为基线

④特征提取

计算每个通道在任务期相对静息期的HbO2浓度变化(ΔHbO2)。重点分析CH5(左DLPFC) 和CH3(右DLPFC) 两个通道。

⑤统计分析

独立样本t检验比较AI组与传统组在左右DLPFC的ΔHbO2差异

计算Cohen‘s d作为效应量

将ΔHbO2作为特征之一,与面部表情数据融合,输入机器学习分类器(CatBoost等)预测创意表现等级

方法的应用启示

适用情境

虽然本研究聚焦于创造性思维学习,但其核心方法范式——同步采集外显情绪(面部表情)与中枢神经活动(fNIRS)——可广泛应用于人机协同学习场景和真实课堂中的同伴协作学习场景。

个人思考

研究发现了“敬畏(awe)”和“惊恐厌恶(appall)”这两种复合情绪在AI组的显著升高。但复合情绪的面部编码(如awe = AU1+2+4+5+20+25+26)本质上是多个基本动作单元的叠加。问题在于:同样的面部动作组合,在不同个体或不同文化背景下,是否一定指向同一种内在体验? 研究者需要谨慎避免过度推论。

研究将DLPFC的激活直接与情绪加工关联,并引用了经典的“左侧积极/右侧消极”情绪侧化理论。但fNIRS的空间分辨率有限(约2–3 cm),且DLPFC本身也参与工作记忆、认知控制、决策等非情绪功能。在没有独立情绪诱发校验(如同时采集皮肤电或心率)的情况下,将HbO2变化直接解释为“情绪反应”需要更谨慎的三角验证。

值得探讨的新问题

东方文化背景下,“敬畏”和“惊恐厌恶”的面部表达模式是否与西方样本一致?fNIRS的情绪侧化效应是否具有跨文化稳定性?

如果未来课堂真的用摄像头+fNIRS实时监测学生的情绪和脑活动,这是“精准教学”还是“神经监视”?谁来拥有这些数据?学生能否拒绝?

能否将面部表情+fNIRS与眼动追踪(注视模式反映认知策略)、皮肤电(反映生理唤醒)结合,构建一个更完整的“认知‑情感‑行为”三维模型?

论文的基本信息

Song, X., Zhang, Y., Lu, Z., Xu, L., & Shen, H. (2026). Generative AI: A double-edged sword for creative thinking learning—Evidence from facial expressions and fNIRS. Computers & Education, 105578.

锐晴对fNIRS与表情识别的多模态同步设计分析得很透彻,特别是你点出DLPFC激活需谨慎归因于情绪这一点,很有方法意识。顺着这个思路,如果未来想将这套范式迁移到真实课堂的长期协作场景,你考虑过如何在保持生态效度的同时,解决fNIRS设备成本高、头帽佩戴不适对自然状态的影响?或者是否有更轻量的替代方案(如便携式近红外)能平衡数据质量与可推广性?

谢谢老师的提问!fNIRS设备成本高、头帽佩戴不适也是在应用过程中需要考虑的重要因素,解决的方法的话目前我想到的是在正式实验前先进行预实验等,让学生适应在课上佩戴设备的感觉,也确实可以考虑使用更轻量级的近红外设备,比如老师提到的便携式近红外设备,这样成本更低,数据采集也更方便。

锐晴最后提出的新问题课堂数据使用的伦理问题,不知道是否有研究或纲领给出了标准操作规范呢~

(补字数)文章清晰易懂,图像明确生动,但ai组的恐惧等不安的情绪出现的深层次原因不明,是由于学生比较熟系传统工具,还是对ai评价或者影响的不安

这篇研究的研究设计真的太有巧思和前沿性了,完全跳出了传统只看学习成绩、主观问卷的老套路。还抛出了跨文化验证、教育伦理、多生理指标融合这些值得深挖的新问题,不只是得出结果,还为后续同领域研究留足了方法论延伸空间,很有学术价值和启发意义。

这项研究揭示了AI支持下创意表现背后的情绪代价,将表情识别、fNIRS和专家评分放在一起比单纯问卷更有说服力,也更贴近真实课堂。DLPFC激活需谨慎归因于情绪的思考对我也非常有启发,把右侧前额叶激活直接解释成负面情绪,缺少一定的理论解释,毕竟认知负荷和紧张感也可能混在里面,最后的伦理问题也值得深思,AI进课堂可以赋能,但若发展成持续监测学生表情和脑活动,就需要谈边界、同意和数据归属。

本研究采用多模态量化研究范式——同步采集面部表情(外显情绪)、fNIRS(前额叶脑血氧)和专家创意评分,通过功能性近红外光谱(fNIRS)捕捉了被试的情绪,很多研究可能使用量表式来调查相关的潜变量或横截面问卷调查。但是有一个点,这样的实验仪器是否能开展真实场景下的长程研究?研究伦理审查问题仍然需要得到重视,数据隐私等问题以及安全性也需要考虑

这篇文章关注到了长期以来被“AI+教育”研究忽视的一个重要问题——用户的情绪反应,以往关于AI对教育影响的研究,往往只关注两个指标:第一,人机协作成果分数;第二,学生的学习动机、需求、兴趣等的常规心理指标变化有没有在AI的干预下提升。研究结果通常显示AI非常有用,比如方案设计更完善、创意更新颖、学习动机与兴趣显著提高等。这篇文章很有意思的点就是发现AI在改善学生表现的同时,也可能增加其消极情绪。但该研究为了控制参与实验的样本个体差异而选取了新手学习者,缺乏使用AI辅助学习的经验,这些学生在AI介入干预学习过程中会不会因操作不熟练或困难、AI生成的答案更完美或更复杂就产生压力? 其次,先头脑风暴,后TRIZ设计的实验流程与单独完成某一任务相比,会对被试产生不同的心理影响吗?

谢谢锐晴带来这么前沿的方法分享,同时采脑、读脸、评结果,而且是在真实任务中完成的,感觉这种这种生态效度真的很难得,不过就像锐晴帖子后面提到的跨文化问题稳定性以及大范围应用可能带来的伦理问题,我也在想,这种前沿的技术方法,现阶段最合适、也最可接受的应用场景应该是什么?